Pensar rápido y despacio Resumen | Daniel Kahneman

Resumen de 1 frase de Pensar rápido y despacio

En el libro Pensar rápido y despacio, Daniel Kahneman habla de dos sistemas de pensamiento: El Sistema 1 y el Sistema 2. El Sistema 1 es rápido, automático e intuitivo, mientras que el Sistema 2 es lento, deliberado y analítico.

La vida es muy ajetreada. Tiene Pensar rápido y despacio de Daniel Kahneman ha estado acumulando polvo en su estantería? En lugar de eso, coja ahora las ideas clave.

En este resumen de "Pensar rápido y despacio" no hemos hecho más que arañar la superficie. Si aún no tiene el libro, pídalo. aquí o consiga el audiolibro para gratis en Amazon para conocer los jugosos detalles.

Sobre Daniel Kahneman

Daniel Kahneman es profesor emérito de Psicología y Asuntos Públicos en la Escuela de Asuntos Públicos e Internacionales de Princeton, profesor emérito de Psicología Eugene Higgins en la Universidad de Princeton y miembro del Centro de Racionalidad de la Universidad Hebrea de Jerusalén. El Dr. Kahneman es miembro de la Academia Nacional de Ciencias, la Sociedad Filosófica y la Academia Americana de Artes y Ciencias. También es miembro de la American Psychological Association, la American Psychological Society, la Society of Experimental Psychologists y la Econometric Society. En 2015, The Economist lo incluyó en la lista de los séptimos economistas más influyentes del mundo. En 2002, Kahneman también recibió el Premio Nobel de Economía.

Listen to El resumen en audiolibro de Pensar rápido y despacio

Sinopsis

Pensamiento rápido y lento ofrece un resumen de los dos enfoques más comunes que utiliza nuestro cerebro. Al igual que un ordenador, nuestro cerebro está formado por sistemas. El sistema 1 es rápido, intuitivo y emocional. Daniel Kahneman nos anima a dejar de depender de este sistema. El sistema 1 es la fuente más común de errores y estancamiento. En comparación, el sistema 2 es un proceso de pensamiento más lento, deliberado y lógico. Kahneman recomienda recurrir a este sistema con más frecuencia. Además de este consejo, Kahneman nos orienta sobre cómo y por qué tomamos nuestras decisiones.

StoryShot #1: El sistema 1 es innato

Hay dos sistemas asociados a nuestros procesos de pensamiento. Para cada sistema, Kahneman esboza las funciones principales y los procesos de toma de decisiones asociados a cada sistema.

El sistema 1 incluye todas las capacidades que son innatas y generalmente compartidas con criaturas similares dentro del reino animal. Por ejemplo, cada uno de nosotros nace con la capacidad innata de reconocer objetos, orientar nuestra atención a estímulos importantes y temer cosas relacionadas con la muerte o la enfermedad. El sistema 1 también se ocupa de las actividades mentales que se han vuelto casi innatas al volverse más rápidas y automáticas. Estas actividades suelen pasar al sistema 1 debido a la práctica prolongada. Ciertas piezas de conocimiento serán automáticas para ti. Por ejemplo, ni siquiera tiene que pensar en cuál es la capital de Inglaterra. Con el tiempo, ha creado una asociación automática con la pregunta "¿Cuál es la capital de Inglaterra? Además de los conocimientos intuitivos, el sistema 1 también se ocupa de las habilidades aprendidas, como leer un libro, montar en bicicleta y saber cómo actuar en situaciones sociales comunes.

También hay ciertas acciones que, por lo general, pertenecen al sistema 1 pero que también pueden caer en el sistema 2. Este solapamiento se produce si se hace un esfuerzo deliberado para realizar esa acción. Por ejemplo, masticar suele pertenecer al sistema 1. Dicho esto, supongamos que nos damos cuenta de que deberíamos masticar la comida más de lo que lo hemos hecho. En ese caso, algunas de tus conductas de masticación se desplazarán al sistema 2 de esfuerzo.

La atención suele estar asociada a los dos sistemas 1 y 2. Funcionan de forma conjunta. Por ejemplo, el sistema 1 dirigirá su reacción involuntaria inmediata a un sonido fuerte. A continuación, el sistema 2 tomará el relevo y ofrecerá una atención voluntaria a este sonido y un razonamiento lógico sobre la causa del mismo.

El sistema 1 es un filtro con el que interpretas tus experiencias. Es el sistema que utilizas para tomar decisiones intuitivas. Por lo tanto, es sin duda el sistema cerebral más antiguo, ya que es evolutivamente primitivo. El sistema 1 también es inconsciente y se basa en los impulsos. Aunque puedas sentir que el sistema 1 no tiene un impacto significativo en tu vida, influye en muchas de tus elecciones y juicios.

StoryShot #2: El sistema 2 puede controlar partes del sistema 1

El sistema 2 comprende una serie de actividades. Pero cada una de estas actividades requiere atención y se interrumpe cuando se desvía la atención. Sin la atención, el rendimiento de estas actividades disminuye. El sistema 2 puede modificar el funcionamiento del sistema 1. Por ejemplo, la detección es generalmente un acto del sistema 1. A través del sistema 2, puedes programar la búsqueda de una persona concreta entre la multitud. Este cebado del sistema 2 permite que el sistema 1 funcione mejor, lo que significa que es más probable que encuentres a esa persona concreta en la multitud. Es el mismo proceso que utilizamos cuando completamos una sopa de letras.

Dado que las actividades del sistema 2 requieren atención, suelen suponer un mayor esfuerzo que las del sistema 1. También es difícil realizar simultáneamente más de una actividad del sistema 2. Las únicas tareas que pueden realizarse simultáneamente se sitúan en los límites inferiores del esfuerzo; por ejemplo, mantener una conversación mientras se conduce. Dicho esto, no es conveniente mantener una conversación mientras se adelanta a un camión en una carretera estrecha. Esencialmente, cuanto más atención requiere una tarea, menos viable es estar completando otra tarea del sistema 2 simultáneamente.

El Sistema 2 es más joven, ya que se ha desarrollado en los últimos miles de años. El Sistema 2 se ha vuelto cada vez más importante a medida que nos adaptamos a la modernización y al cambio de prioridades. La mayoría de las operaciones del segundo sistema requieren una atención consciente, como por ejemplo dar a alguien tu número de teléfono. Las operaciones del sistema 2 se asocian a menudo con la experiencia subjetiva de agencia, elección y concentración. Cuando pensamos en nosotros mismos, nos identificamos con el sistema 2. Es el yo consciente y razonador que tiene creencias, hace elecciones y decide en qué pensar y qué hacer.

StoryShot #3: Los dos sistemas se apoyan mutuamente

Basándose en las descripciones de los dos sistemas, podría ser fácil imaginar que los sistemas se producen uno tras otro. Kahneman explica que estos dos sistemas están en realidad integrados y se apoyan mutuamente. Así, casi todas las tareas son una mezcla de ambos sistemas y se complementan. Por ejemplo, las emociones (sistema 1) son cruciales para adoptar un razonamiento lógico (sistema 2). Las emociones hacen que nuestra toma de decisiones tenga más sentido y sea más eficaz.

Otro ejemplo de que los dos sistemas funcionan a la par es cuando hacemos deporte. Ciertas partes del deporte serán acciones automáticas. Pensemos en un partido de tenis. El tenis utilizará la carrera, que es una habilidad innata en los humanos y está controlada por el sistema 1. Golpear una pelota también puede convertirse en una actividad del sistema 1 a través de la práctica. Dicho esto, siempre habrá golpes específicos o decisiones tácticas que requerirán su sistema 2. Por lo tanto, ambos sistemas se complementan al practicar un deporte, como el tenis.

Los problemas pueden surgir cuando la gente confía demasiado en su sistema 1, ya que requiere menos esfuerzo. Otros problemas están relacionados con las actividades que están fuera de su rutina. Es entonces cuando los sistemas 1 y 2 entran en conflicto.

StoryShot #4: La heurística como atajo mental

La segunda parte del libro introduce el concepto de heurística. Los heurísticos son atajos mentales que creamos al tomar decisiones. Siempre buscamos resolver los problemas con la mayor eficacia posible. Por tanto, la heurística es muy beneficiosa para conservar la energía en nuestra vida cotidiana. Por ejemplo, nuestra heurística nos ayuda a aplicar automáticamente conocimientos previos a circunstancias ligeramente diferentes. Aunque la heurística puede ser positiva, también es esencial considerar que la heurística es fuente de prejuicios. Por ejemplo, puedes tener una experiencia negativa con una persona de un grupo étnico concreto. Si confía únicamente en su heurística, puede estereotipar a otras personas del mismo grupo étnico. La heurística también puede provocar sesgos cognitivos, errores sistémicos de pensamiento, malas decisiones o una interpretación errónea de los acontecimientos.

StoryShot #5: Los prejuicios que creamos en nuestra propia mente

Kahneman presenta ocho sesgos y heurísticas comunes que pueden llevar a una mala toma de decisiones:

- La ley de los números pequeños: Esta ley muestra nuestra creencia fuertemente sesgada de que los números más pequeños o las muestras se parecen a la población de la que proceden. La gente subestima la variabilidad de las muestras pequeñas. Dicho de otro modo, la gente sobreestima lo que puede conseguir un estudio pequeño. Digamos que un fármaco tiene éxito en el 80% de los pacientes. ¿Cuántos pacientes responderán si se tratan cinco? En realidad, de una muestra de 5, sólo hay una probabilidad de 41% de que respondan exactamente cuatro personas.

- Anclaje: Cuando las personas toman decisiones, tienden a depender más de la información preexistente o de la primera información que encuentran. Esto se conoce como sesgo de anclaje. Si ves por primera vez una camiseta que cuesta $1.200 y luego ves una segunda que cuesta $100, es más probable que descartes la segunda camiseta. Si acabas de ver la segunda camiseta, que cuesta $100, no la considerarías barata. El ancla -el primer precio que viste- tuvo un impacto indebido en tu decisión.

- Cebado: Nuestra mente funciona haciendo asociaciones entre palabras y elementos. Por lo tanto, somos susceptibles de ser primados. Una asociación común puede ser invocada por cualquier cosa y llevarnos en una dirección determinada con nuestras decisiones. Kahneman explica que el priming es la base de los nudges y de la publicidad que utiliza imágenes positivas. Por ejemplo, Nike se ceba con los sentimientos de ejercicio y logro. Cuando empiezan a practicar un nuevo deporte o quieren mantener su forma física, los consumidores suelen pensar en los productos de Nike. Nike apoya a los atletas profesionales y utiliza eslóganes como "Just Do It" para demostrar el éxito y la perseverancia de los atletas. He aquí otro ejemplo: El propietario de un restaurante que tiene demasiados vinos italianos en stock, puede incitar a sus clientes a comprar este tipo de vino poniendo música italiana de fondo.

- Facilidad cognitiva: Lo que es más fácil para el Sistema 2 es más probable que se crea. La facilidad surge de la repetición de la idea, de una exposición clara, de una idea preparada e incluso del propio buen humor. Resulta que incluso la repetición de una falsedad puede llevar a la gente a aceptarla, a pesar de saber que es falsa, ya que el concepto se vuelve familiar y es cognitivamente fácil de procesar. Un ejemplo de esto sería un individuo que está rodeado de personas que creen y hablan de una noticia falsa. Aunque la evidencia sugiere que esta idea es falsa, la facilidad de procesar esta idea hace que creerla sea mucho más fácil.

- Sacar conclusiones precipitadas: Kahneman sugiere que nuestro sistema 1 es una máquina que funciona sacando conclusiones. Estas conclusiones se basan en que "lo que ves es todo lo que hay". En efecto, el sistema 1 saca conclusiones a partir de la información disponible y, a veces, engañosa. Una vez sacadas estas conclusiones, creemos en ellas hasta el final. El impacto medido de los efectos de halo, el sesgo de confirmación, los efectos de encuadre y el descuido de la tasa de base son aspectos del salto a las conclusiones en la práctica.

- El efecto halo es cuando se atribuyen más características positivas a una persona o cosa basándose en una impresión positiva. Por ejemplo, creer que una persona es más inteligente de lo que realmente es porque es guapa.

- Sesgo de confirmación se produce cuando se tiene una determinada creencia y se busca la información que la respalda. También se ignora la información que cuestiona esta creencia. Por ejemplo, un detective puede identificar a un sospechoso en las primeras fases del caso, pero sólo busca pruebas que lo confirmen en lugar de refutarlo. Las burbujas de filtro o la "edición algorítmica" amplifican el sesgo de confirmación en las redes sociales. Los algoritmos lo consiguen mostrando al usuario sólo información y publicaciones con las que probablemente esté de acuerdo, en lugar de exponerle a perspectivas opuestas.

- Efectos de encuadre se refieren a cómo el contexto de un dilema puede influir en el comportamiento de las personas. Por ejemplo, las personas tienden a evitar el riesgo cuando se presenta un marco positivo y a buscarlo cuando se presenta un marco negativo. En un estudio, cuando se introdujo una penalización por inscripción tardía, 93% de los estudiantes de doctorado se inscribieron antes. Pero el porcentaje disminuyó a 67% cuando se presentó como un descuento por inscripción anticipada.

- Finalmente, descuido de la tasa de base o falacia de la tasa de base se relaciona con nuestra tendencia a centrarnos en la información individualizada en lugar de la información de base. La información individualizada es específica de una persona o un acontecimiento determinado. La información de base es una información objetiva y estadística. Tendemos a dar más valor a la información específica y a menudo ignoramos la información de base. Por tanto, es más probable que hagamos suposiciones basadas en características individuales que en la prevalencia de algo en general. La paradoja del falso positivo es un ejemplo de la falacia de la tasa base. Hay casos en los que hay un mayor número de falsos positivos que de verdaderos positivos. Por ejemplo, 100 de cada 1.000 personas dan positivo en una prueba de infección, pero sólo 20 tienen realmente la infección. Esto sugiere que 80 pruebas fueron falsos positivos. La probabilidad de que los resultados sean positivos depende de varios factores, como la precisión de las pruebas y las características de la población muestreada. La prevalencia, es decir, la proporción de personas que padecen una determinada enfermedad, puede ser inferior a la tasa de falsos positivos de la prueba. En tal situación, incluso las pruebas que tienen una probabilidad muy baja de producir un falso positivo en un caso individual dará más falsos positivos que verdaderos positivos en general. He aquí otro ejemplo: Aunque la única persona de tu curso optativo de Química parezca y actúe como un estudiante de medicina tradicional, las posibilidades de que esté estudiando medicina son escasas. Esto se debe a que los programas de medicina suelen tener sólo un centenar de alumnos, en comparación con los miles de estudiantes que se matriculan en otras facultades como Empresariales o Ingeniería. Aunque sea fácil hacer juicios rápidos sobre las personas basándose en información específica, no debemos permitir que esto borre por completo la información estadística de base.

- Disponibilidad: El sesgo de disponibilidad se produce cuando tenemos en cuenta un acontecimiento destacado, una experiencia reciente o algo que nos resulta especialmente vívido, para emitir nuestros juicios. Las personas que se guían por el Sistema 1 son más susceptibles al sesgo de disponibilidad que otras. Un ejemplo de este sesgo sería escuchar las noticias y oír que ha habido un gran accidente de avión en otro país. Si tienes un vuelo la semana siguiente, podrías tener una creencia desproporcionada de que tu vuelo también se va a estrellar.

- La falacia del coste hundido: Esta falacia se produce cuando la gente sigue invirtiendo recursos adicionales en una cuenta perdedora a pesar de disponer de mejores inversiones. Por ejemplo, cuando los inversores permiten que el precio de compra de una acción determine cuándo pueden venderla, caen en la falacia del coste hundido. La tendencia de los inversores a vender demasiado pronto las acciones ganadoras y a mantener las perdedoras durante demasiado tiempo está bien estudiada. Otro ejemplo es la permanencia en una relación de larga duración a pesar de ser emocionalmente perjudicial. Temen volver a empezar porque significa que todo lo que hicieron en el pasado no sirvió para nada, pero este miedo suele ser más destructivo que el de dejar ir. Esta falacia es también la razón por la que la gente se vuelve adicta al juego. Para hacer frente a esta falacia hay que evitar la escalada de compromiso con algo que podría fracasar.

StoryShot #6: Regresión a la media

La regresión a la media es el hecho estadístico de que cualquier secuencia de ensayos acabará convergiendo a la media. A pesar de ello, los seres humanos tienden a identificar las rachas de suerte y de mala suerte como una señal de resultados futuros, por ejemplo, he perdido cinco tiradas de máquina tragaperras seguidas, así que me toca ganar. Esta creencia está asociada a varias deficiencias mentales que Kahneman considera:

- Ilusión de comprensión: Construimos relatos para dar sentido al mundo. Buscamos causalidad donde no la hay.

- Ilusión de validez: Los expertos, los seleccionadores de valores y otros expertos desarrollan un sentido de pericia exagerado.

- Intuición de los expertos: Los algoritmos aplicados con disciplina suelen superar a los expertos y su sentido de la intuición.

- Falacia de planificación: Esta falacia se produce cuando las personas sobrestiman los resultados positivos de una experiencia basada en el azar porque han planificado la ocasión.

- El optimismo y el engaño empresarial: La mayoría de las personas tienen un exceso de confianza, tienden a descuidar a los competidores y creen que superarán a la media.

StoryShot #7: La retrospectiva influye significativamente en la toma de decisiones

Utilizando diversos elementos, Daniel Kahneman muestra lo poco que comprendemos de nuestro pasado. Menciona la retrospectiva, un sesgo que tiene un efecto especialmente negativo en el proceso de toma de decisiones. En concreto, la retrospectiva desplaza la medida utilizada para evaluar la solidez de las decisiones. Este cambio desplaza la medida del propio proceso a la naturaleza del resultado. Kahneman señala que acciones que parecían prudentes en la previsión pueden parecer irresponsablemente negligentes en la retrospectiva.

Una limitación general de los seres humanos es nuestra incapacidad para reconstruir con precisión estados de conocimiento o creencias pasados que han cambiado. El sesgo retrospectivo tiene un impacto significativo en las evaluaciones de los responsables de la toma de decisiones. Lleva a los observadores a evaluar la calidad de una decisión no por si el proceso fue acertado, sino por si su resultado fue bueno o malo.

La retrospectiva es especialmente cruel con los responsables de tomar decisiones que actúan como agentes de otros: médicos, asesores financieros, entrenadores de tercera base, directores generales, trabajadores sociales, diplomáticos y políticos. Somos propensos a culpar a los responsables de la toma de decisiones por las buenas decisiones que han salido mal. También les damos muy poco crédito por acciones exitosas que sólo parecen evidentes después de los resultados. Así que, dentro de los seres humanos, existe un claro sesgo hacia los resultados.

Aunque la retrospectiva y el sesgo de los resultados suelen fomentar la aversión al riesgo, también aportan recompensas inmerecidas a los buscadores de riesgos irresponsables. Un ejemplo de ello son los empresarios que asumen apuestas alocadas y ganan por suerte. Los líderes con suerte tampoco son castigados por haber asumido demasiados riesgos.

StoryShot #8: Aversión al riesgo

Kahneman señala que los seres humanos tienden a tener aversión al riesgo, es decir, tienden a evitarlo siempre que pueden. A la mayoría de las personas les disgusta el riesgo por la posibilidad de recibir el menor resultado posible. Por eso, si se les ofrece la posibilidad de elegir entre una apuesta y una cantidad igual a su valor esperado, elegirán lo seguro. El valor esperado se calcula multiplicando cada uno de los posibles resultados por la probabilidad de que se produzca cada uno de ellos y sumando todos esos valores. Un tomador de decisiones con aversión al riesgo elegirá una cosa segura que sea menor que el valor esperado del riesgo. En efecto, está pagando una prima para evitar la incertidumbre.

StoryShot #9: Aversión a las pérdidas

Kahneman también introduce el concepto de aversión a la pérdida. Muchas de las opciones a las que nos enfrentamos en la vida son una mezcla de pérdida y ganancia potencial. Hay un riesgo de pérdida y una oportunidad de ganancia. Por tanto, debemos decidir si aceptamos la apuesta o la rechazamos.

La aversión a las pérdidas se refiere a la fuerza relativa de dos motivos: nos impulsa más evitar las pérdidas que conseguir ganancias. Un punto de referencia es a veces el statu quo, pero también puede ser un objetivo en el futuro. Por ejemplo, no alcanzar un objetivo es una pérdida; superarlo es una ganancia.

Los dos motivos no son igual de poderosos. La aversión al fracaso es mucho más fuerte que la motivación para obtener un objetivo. Por eso, las personas suelen adoptar objetivos a corto plazo que se esfuerzan por alcanzar pero no necesariamente por superar. Es probable que reduzcan sus esfuerzos cuando hayan alcanzado objetivos inmediatos. Esto significa que sus resultados pueden a veces violar la lógica económica.

Kahneman también explica que las personas atribuyen valor a las ganancias y a las pérdidas más que a la riqueza. Por tanto, las ponderaciones de decisión que asignan a los resultados son diferentes de las probabilidades. Las personas que se enfrentan a opciones terribles hacen apuestas desesperadas, aceptando una alta probabilidad de empeorar las cosas a cambio de una pequeña esperanza de evitar una gran pérdida. La asunción de riesgos de este tipo suele convertir fracasos manejables en desastres. Como la derrota es tan difícil de aceptar, el bando perdedor en las guerras suele luchar mucho tiempo después de que la victoria esté garantizada para el otro bando.

StoryShot #10: No confíe en que sus preferencias reflejen sus intereses

Sobre las decisiones, Daniel Kahneman sugiere que todos mantenemos la suposición de que nuestras decisiones son en nuestro mejor interés. Esto no suele ser así. Nuestros recuerdos, que no siempre son correctos o se interpretan de forma adecuada, suelen influir significativamente en nuestras elecciones.

Las decisiones que no producen la mejor experiencia posible son una mala noticia para los creyentes en la racionalidad de la elección. No podemos confiar plenamente en que nuestras preferencias reflejen nuestros intereses. Esta falta de confianza es real, incluso si se basan en la experiencia personal y los recuerdos recientes.

StoryShot #11: Los recuerdos determinan nuestras decisiones

Los recuerdos determinan nuestras decisiones. Lo más preocupante es que nuestros recuerdos pueden ser erróneos. La incoherencia está integrada en el diseño de nuestras mentes. Tenemos fuertes preferencias en cuanto a la duración de nuestras experiencias de dolor y placer. Queremos que el dolor sea breve y que el placer sea duradero. Nuestra memoria, una función del Sistema 1, ha evolucionado para representar los momentos más intensos de un episodio de dolor o placer. Una memoria que descuida la duración no servirá para nuestra preferencia por los placeres largos y los dolores cortos.

Un único valor de felicidad no representa fácilmente la experiencia de un momento o un episodio. Aunque existen simultáneamente emociones positivas y negativas, es posible clasificar la mayoría de los momentos de la vida como positivos o negativos en última instancia. El estado de ánimo de un individuo en cualquier momento depende de su temperamento y de su felicidad general. Aun así, el bienestar emocional también fluctúa diaria y semanalmente. El estado de ánimo del momento depende principalmente de la situación actual.

Pensar rápido y despacio Resumen y reseña

Pensamiento rápido y lento esboza la forma en que funcionan todas las mentes humanas. Todos tenemos dos sistemas que se apoyan mutuamente y trabajan en tándem. El problema es cuando confiamos demasiado en nuestro sistema rápido e impulsivo 1. Esta dependencia excesiva conduce a una amplia gama de sesgos que pueden influir negativamente en la toma de decisiones. La clave es entender de dónde vienen estos sesgos y utilizar nuestro sistema analítico 2 para mantener nuestro sistema 1 bajo control.

Clasificación

Valoramos Pensar rápido y despacio 4.4/5. ¿Cómo calificaría el libro de Daniel Kahneman basándose en este resumen? Coméntanoslo a continuación.

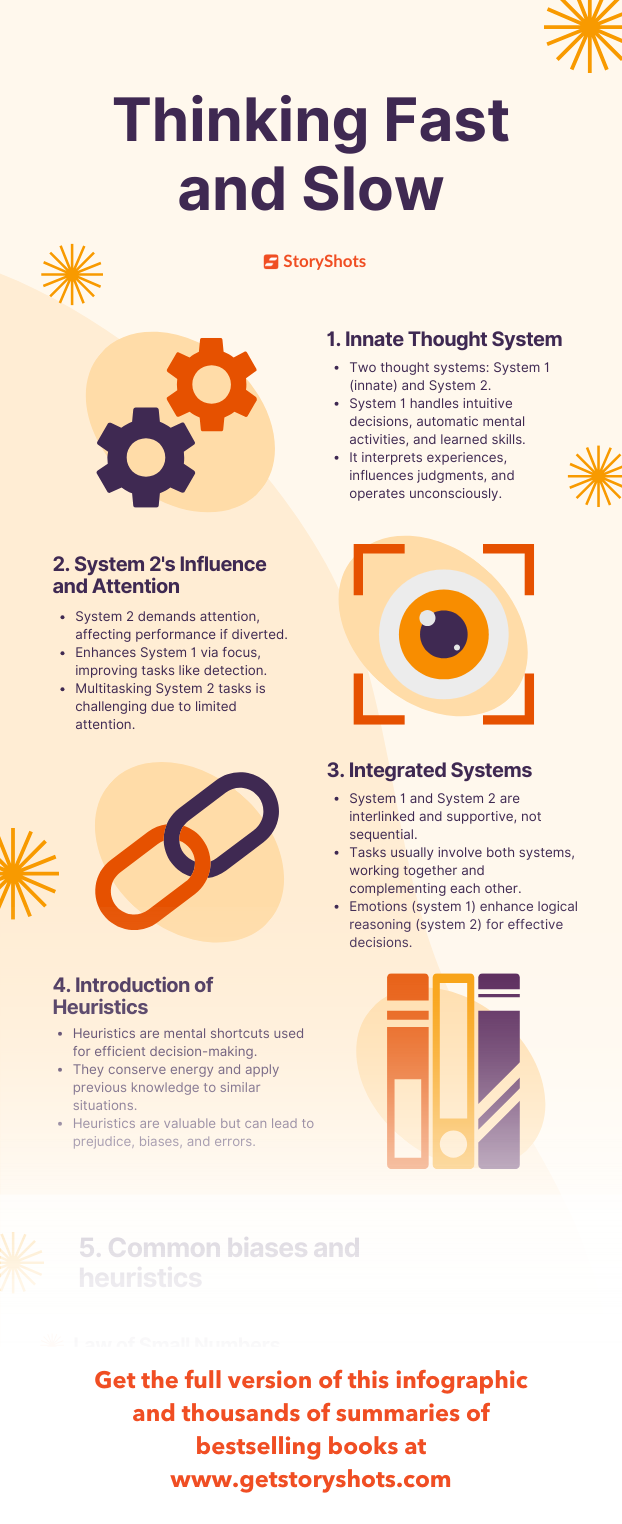

Resumen infográfico

Resumen infográfico completo de Pensar rápido y despacio en la aplicación StoryShots.

Pensar rápido y despacio Resumen PDF, audiolibro gratuito y resumen animado

Esto fue la punta del iceberg. Para sumergirse en los detalles y apoyar al autor, pida el libro o consiga el audiolibro gratis en Amazon.

¿Te han gustado las lecciones que has aprendido aquí? Comenta abajo o comparte para demostrar que te interesa.

¿Eres nuevo en StoryShots? Obtenga el PDF, el audio gratuito y las versiones animadas de este análisis y resumen de Pensar rápido y despacio y de cientos de otros libros de no ficción más vendidos en nuestro aplicación gratuita de primer nivel. Ha sido destacada por Apple, The Guardian, la ONU y Google como una de las mejores aplicaciones de lectura y aprendizaje del mundo.

Resúmenes gratuitos de libros relacionados

Ruido por Daniel Kahneman

Piénsalo de nuevo por Adam Grant

Un empujón a por Richard Thaler

Previsiblemente irracional por Dan Ariely

Flujo por Mihaly Csikszentmihalyi

Daring Greatly por Brené Brown

Cuando por Daniel H. Pink

El cisne negro por Nassim Taleb

Todo está jodido por Mark Manson

Seis sombreros para pensar por Edward De Bono

Cómo no equivocarse por Jordan Ellenberg

Hablar con extraños por Malcolm Gladwell

Tao Te Ching por Laozi

Caminando por la luna con Einstein por Joshua Foer

Freakonomics por Stephen Dubner y Steven Levitt

Las leyes de la naturaleza humana por Robert Greene

Un comentario