Résumé de Thinking Fast and Slow | Daniel Kahneman

Résumé en 1 phrase de Penser vite et lentement

Dans l'ouvrage Thinking, Fast and Slow, Daniel Kahneman évoque deux systèmes de pensée : Le système 1 est rapide, automatique et intuitif, tandis que le système 2 est lent, délibéré et analytique.

La vie s'active. A Penser vite et lentement de Daniel Kahneman a pris la poussière sur votre étagère ? Prenez plutôt les idées clés dès maintenant.

Nous ne faisons qu'effleurer la surface dans ce résumé de Penser vite et lentement. Si vous n'avez pas encore le livre, commandez-le ici ou obtenez le livre audio pour gratuit sur Amazon pour connaître les détails juteux.

À propos de Daniel Kahneman

Daniel Kahneman est professeur émérite de psychologie et d'affaires publiques à la Princeton School of Public and International Affairs, professeur émérite de psychologie Eugene Higgins à l'université de Princeton et membre du Center for Rationality de l'université hébraïque de Jérusalem. M. Kahneman est membre de la National Academy of Science, de la Philosophical Society et de l'American Academy of Arts and Sciences. Il est également membre de l'American Psychological Association, de l'American Psychological Society, de la Society of Experimental Psychologists et de l'Econometric Society. En 2015, The Economist l'a classé comme le septième économiste le plus influent au monde. En 2002, Kahneman a également reçu le prix Nobel de sciences économiques.

Écouter le résumé du livre audio Thinking Fast and Slow (en anglais)

Synopsis

La pensée, rapide et lente donne un aperçu des deux approches les plus courantes utilisées par notre cerveau. Comme un ordinateur, notre cerveau est constitué de systèmes. Le système 1 est rapide, intuitif et émotionnel. Daniel Kahneman nous encourage à ne plus dépendre de ce système. Le système 1 est la source la plus courante d'erreurs et de stagnation. En comparaison, le système 2 est un processus de pensée plus lent, plus délibéré et plus logique. Kahneman recommande de faire appel à ce système plus fréquemment. Outre ces conseils, Kahneman fournit des indications sur la manière dont nous prenons nos décisions et sur les raisons de ces décisions.

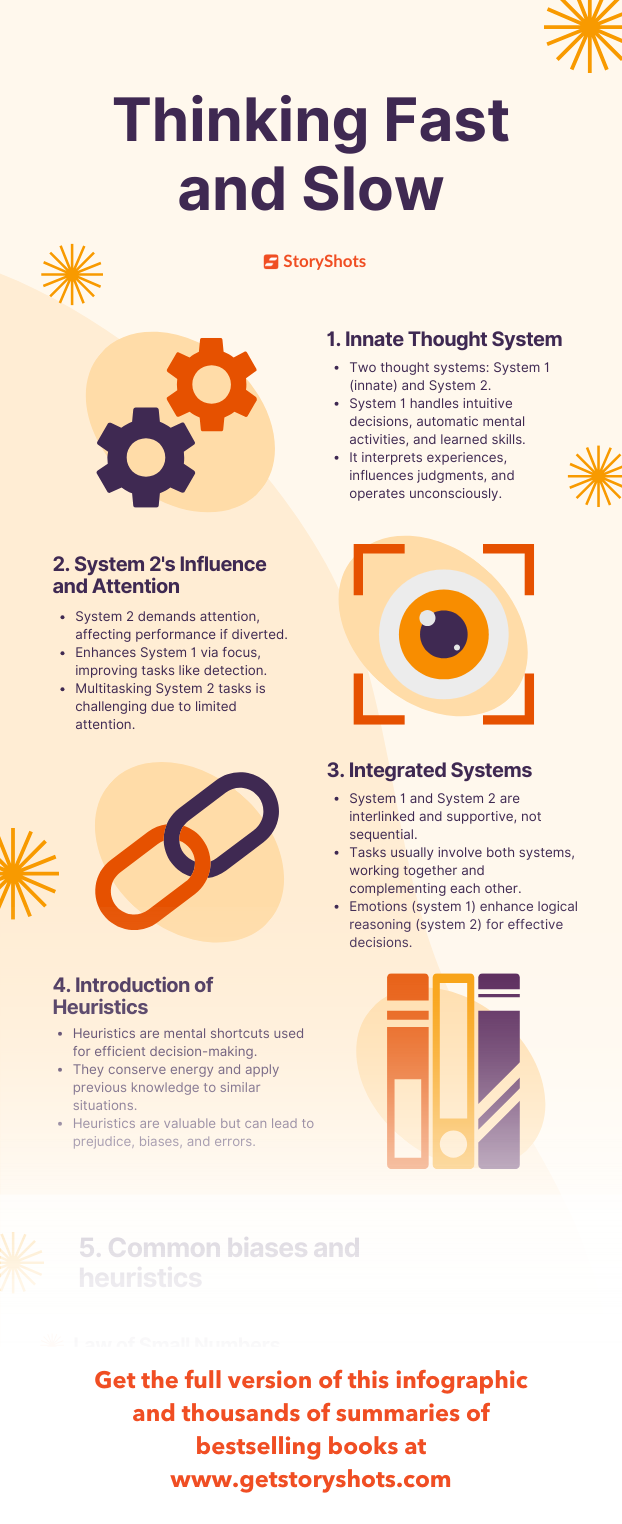

StoryShot #1 : Le Système 1 est inné

Il existe deux systèmes associés à nos processus de pensée. Pour chaque système, Kahneman décrit les fonctions primaires et les processus de prise de décision associés à chaque système.

Le système 1 comprend toutes les capacités qui sont innées et généralement partagées avec des créatures similaires au sein du règne animal. Par exemple, chacun d'entre nous naît avec une capacité innée à reconnaître les objets, à orienter son attention vers les stimuli importants et à craindre les choses liées à la mort ou à la maladie. Le système 1 traite également des activités mentales qui sont devenues quasi innées en devenant plus rapides et plus automatiques. Ces activités passent généralement dans le système 1 en raison d'une pratique prolongée. Certaines connaissances seront automatiques pour vous. Par exemple, vous n'avez même pas besoin de réfléchir pour savoir quelle est la capitale de l'Angleterre. Au fil du temps, vous avez construit une association automatique avec la question "Quelle est la capitale de l'Angleterre". Outre les connaissances intuitives, le système 1 traite également des compétences acquises, telles que lire un livre, faire du vélo et savoir comment agir dans des situations sociales courantes.

Il y a aussi certaines actions qui relèvent généralement du système 1 mais qui peuvent aussi tomber dans le système 2. Ce chevauchement se produit si vous faites un effort délibéré pour vous engager dans cette action. Par exemple, la mastication relève généralement du système 1. Cela dit, supposons que vous vous rendiez compte que vous devriez mâcher votre nourriture plus que vous ne l'avez fait. Dans ce cas, certains de vos comportements de mastication seront déplacés vers le système 2, qui exige des efforts.

L'attention est souvent associée aux deux systèmes 1 et 2. Ils fonctionnent en tandem. Par exemple, le système 1 sera à l'origine de votre réaction involontaire immédiate à un son fort. Votre système 2 prendra ensuite le relais et vous offrira une attention volontaire à ce son et un raisonnement logique sur la cause du son.

Le système 1 est un filtre par lequel vous interprétez vos expériences. C'est le système que vous utilisez pour prendre des décisions intuitives. Il s'agit donc sans aucun doute du système cérébral le plus ancien, car il est primitif du point de vue de l'évolution. Le système 1 est également inconscient et guidé par les impulsions. Bien que vous puissiez avoir l'impression que le système 1 n'a pas d'impact significatif sur votre vie, il influence nombre de vos choix et jugements.

StoryShot #2 : Le système 2 peut contrôler des parties du système 1

Le système 2 comprend une série d'activités. Mais chacune de ces activités requiert de l'attention et est perturbée lorsque l'attention est détournée. Sans attention, vos performances dans ces activités diminueront. De manière significative, le système 2 peut modifier le fonctionnement du système 1. Par exemple, la détection est généralement un acte du système 1. Vous pouvez vous programmer, via le système 2, pour rechercher une personne spécifique dans une foule. Cet amorçage par le système 2 permet au système 1 de mieux fonctionner, ce qui signifie que vous avez plus de chances de trouver la personne en question dans la foule. Il s'agit du même processus que celui que nous utilisons lorsque nous effectuons une recherche de mots.

Comme les activités du système 2 requièrent de l'attention, elles sont généralement plus exigeantes que celles du système 1. Il est également difficile d'effectuer simultanément plus d'une activité du système 2. Les seules tâches qui peuvent être accomplies simultanément se situent dans les limites inférieures de l'effort ; par exemple, tenir une conversation tout en conduisant. Cela dit, il n'est pas judicieux de tenir une conversation tout en dépassant un camion sur une route étroite. En fait, plus une tâche requiert d'attention, moins il est possible d'accomplir simultanément une autre tâche du système 2.

Le système 2 est plus jeune, s'étant développé au cours des derniers milliers d'années. Le système 2 est devenu de plus en plus important à mesure que nous nous adaptons à la modernisation et aux changements de priorités. La plupart des opérations du deuxième système nécessitent une attention consciente, comme donner son numéro de téléphone à quelqu'un. Les opérations du système 2 sont souvent associées à l'expérience subjective de l'agence, du choix et de la concentration. Lorsque nous pensons à nous-mêmes, nous nous identifions au système 2. Il s'agit du moi conscient et raisonneur qui a des croyances, fait des choix et décide de ce à quoi il faut penser et de ce qu'il faut faire.

StoryShot #3 : Les deux systèmes se soutiennent mutuellement

Sur la base des descriptions des deux systèmes, il pourrait être facile d'imaginer que les systèmes se produisent l'un après l'autre. Kahneman explique que ces deux systèmes sont en fait intégrés et se soutiennent mutuellement. Ainsi, presque toutes les tâches sont un mélange des deux systèmes et sont complémentaires. Par exemple, les émotions (système 1) sont cruciales pour adopter un raisonnement logique (système 2). Les émotions rendent nos décisions plus significatives et plus efficaces.

Un autre exemple de ces deux systèmes fonctionnant en tandem est celui de la pratique d'un sport. Certaines parties du sport seront des actions automatiques. Prenons l'exemple d'un match de tennis. Le tennis fait appel à la course, qui est une aptitude innée chez l'homme et est contrôlée par le système 1. Frapper une balle peut également devenir une activité du système 1 grâce à la pratique. Cela dit, il y aura toujours des coups spécifiques ou des décisions tactiques qui feront appel à votre système 2. Les deux systèmes sont donc complémentaires lorsque vous pratiquez un sport, comme le tennis.

Des problèmes peuvent survenir lorsque les gens se fient trop à leur système 1, car il demande moins d'efforts. D'autres problèmes sont associés aux activités qui sortent de votre routine. C'est alors que les systèmes 1 et 2 entrent en conflit.

StoryShot #4 : L'heuristique comme raccourci mental

La deuxième partie du livre présente le concept d'heuristique. Les heuristiques sont des raccourcis mentaux que nous créons lorsque nous prenons des décisions. Nous cherchons toujours à résoudre les problèmes avec la plus grande efficacité. Les heuristiques sont donc très utiles pour conserver l'énergie dans notre vie quotidienne. Par exemple, nos heuristiques nous aident à appliquer automatiquement des connaissances antérieures à des circonstances légèrement différentes. Bien que les heuristiques puissent être positives, il est également essentiel de considérer qu'elles sont à l'origine de préjugés. Par exemple, vous pouvez avoir une expérience négative avec une personne appartenant à un groupe ethnique spécifique. Si vous vous fiez uniquement à vos heuristiques, vous risquez de stéréotyper d'autres personnes du même groupe ethnique. Les heuristiques peuvent également être à l'origine de biais cognitifs, d'erreurs systémiques de pensée, de mauvaises décisions ou d'une mauvaise interprétation des événements.

StoryShot #5 : Les préjugés que nous créons dans nos propres esprits

Kahneman présente huit biais et heuristiques courants qui peuvent conduire à une mauvaise prise de décision :

- La loi des petits nombres: Cette loi montre notre croyance fortement biaisée que les petits nombres ou échantillons ressemblent à la population dont ils sont issus. Les gens sous-estiment la variabilité des petits échantillons. En d'autres termes, les gens surestiment ce qu'une petite étude peut accomplir. Disons qu'un médicament est efficace chez 80% des patients. Combien de patients répondront au traitement si on en traite cinq ? En réalité, sur un échantillon de 5 personnes, il n'y a que 41% de chances qu'exactement quatre personnes répondent au traitement.

- Ancrage: Lorsque les gens font des choix, ils ont tendance à dépendre plus fortement des informations préexistantes ou des premières informations qu'ils rencontrent. C'est ce qu'on appelle le biais d'ancrage. Si vous voyez d'abord un T-shirt qui coûte $1 200, puis un deuxième qui coûte $100, vous avez plus de chances d'écarter le deuxième T-shirt. Si vous venez de voir le deuxième T-shirt, qui coûte $100, vous ne le considérerez pas comme bon marché. L'ancre - le premier prix que vous avez vu - a eu un impact indu sur votre décision.

- Amorçage: Notre esprit fonctionne en faisant des associations entre des mots et des éléments. Par conséquent, nous sommes sensibles à l'amorçage. Une association commune peut être invoquée par n'importe quoi et nous conduire dans une direction particulière dans nos décisions. Kahneman explique que l'amorçage est à la base des nudges et de la publicité utilisant une imagerie positive. Par exemple, Nike fait appel aux sentiments d'exercice et de réussite. Lorsqu'ils commencent un nouveau sport ou veulent entretenir leur forme physique, les consommateurs sont susceptibles de penser aux produits Nike. Nike soutient les athlètes professionnels et utilise des slogans comme "Just Do It" pour démontrer le succès et la persévérance des athlètes. Voici un autre exemple : Un restaurateur qui a trop de vin italien en stock peut inciter ses clients à acheter ce type de vin en diffusant de la musique italienne en fond sonore.

- Facilité cognitive: Ce qui est plus facile pour le Système 2 a plus de chances d'être cru. La facilité provient de la répétition de l'idée, d'un affichage clair, d'une idée amorcée et même de la bonne humeur de chacun. Il s'avère que même la répétition d'une idée fausse peut amener les gens à l'accepter, même s'ils savent qu'elle est fausse, car le concept devient familier et est cognitivement facile à traiter. Prenons l'exemple d'une personne qui est entourée de personnes qui croient et parlent d'une fausse nouvelle. Bien que les preuves suggèrent que cette idée est fausse, la facilité de traitement de cette idée rend sa croyance beaucoup plus facile.

- Tirer des conclusions hâtives: Kahneman suggère que notre système 1 est une machine qui fonctionne en tirant des conclusions hâtives. Ces conclusions sont basées sur le principe "Ce que vous voyez est tout ce qu'il y a". En effet, le système 1 tire des conclusions sur la base d'informations facilement disponibles et parfois trompeuses. Une fois ces conclusions tirées, nous y croyons jusqu'au bout. L'impact mesuré des effets de halo, du biais de confirmation, des effets de cadrage et de la négligence du taux de base sont des aspects de la pratique des conclusions hâtives.

- L'effet de halo c'est lorsque vous attribuez des caractéristiques plus positives à une personne/chose sur la base d'une impression positive. Par exemple, croire qu'une personne est plus intelligente qu'elle ne l'est en réalité parce qu'elle est belle.

- Biais de confirmation se produit lorsque vous avez une certaine croyance et que vous recherchez des informations qui soutiennent cette croyance. Vous ignorez également les informations qui remettent en cause cette croyance. Par exemple, un détective peut identifier un suspect dès le début de l'affaire, mais ne chercher qu'à confirmer les preuves au lieu de les infirmer. Les bulles de filtres ou "édition algorithmique" amplifient le biais de confirmation dans les médias sociaux. Les algorithmes y parviennent en ne montrant à l'utilisateur que des informations et des messages avec lesquels il est susceptible d'être d'accord, au lieu de l'exposer à des points de vue opposés.

- Effets de cadrage concernent la manière dont le contexte d'un dilemme peut influencer le comportement des gens. Par exemple, les gens ont tendance à éviter le risque lorsqu'un cadre positif est présenté et à rechercher le risque lorsqu'un cadre négatif est présenté. Dans une étude, lorsqu'une pénalité pour inscription tardive a été introduite, 93% des étudiants en doctorat se sont inscrits tôt. Mais ce pourcentage est tombé à 67% lorsqu'elle a été présentée comme une réduction pour une inscription précoce.

- Enfin, négligence du taux de base ou erreur de taux de base est liée à notre tendance à nous concentrer sur les informations individuelles plutôt que sur les informations de base. Les informations individuelles sont spécifiques à une personne ou à un événement donné. L'information de base est une information objective, statistique. Nous avons tendance à accorder une plus grande valeur à l'information spécifique et souvent à ignorer complètement l'information de base. Ainsi, nous sommes plus susceptibles de faire des hypothèses basées sur des caractéristiques individuelles plutôt que sur la prévalence d'un phénomène en général. Le paradoxe du faux positif est un exemple de l'erreur du taux de base. Dans certains cas, le nombre de faux positifs est supérieur à celui des vrais positifs. Par exemple, 100 personnes sur 1 000 ont un test positif pour une infection, mais seules 20 personnes sont réellement atteintes de cette infection. Cela signifie que 80 tests étaient des faux positifs. La probabilité de résultats positifs dépend de plusieurs facteurs, notamment de la précision des tests ainsi que des caractéristiques de la population échantillonnée. La prévalence, c'est-à-dire la proportion de personnes atteintes d'une maladie donnée, peut être inférieure au taux de faux positifs du test. Dans une telle situation, même les tests qui ont une très faible probabilité de produire un faux positif dans un cas individuel donnera plus de faux positifs que de vrais positifs global. Voici un autre exemple : Même si la personne qui suit votre cours facultatif de chimie ressemble et se comporte comme un étudiant en médecine traditionnel, il y a peu de chances qu'elle étudie la médecine. En effet, les programmes de médecine ne comptent généralement qu'une centaine d'étudiants, alors que d'autres facultés comme celles de commerce ou d'ingénierie en comptent des milliers. S'il est facile de porter des jugements rapides sur les gens en se basant sur des informations spécifiques, il ne faut pas que cela efface complètement les informations statistiques de base.

- Disponibilité: Le biais de disponibilité se produit lorsque nous prenons en compte un événement saillant, une expérience récente ou quelque chose de particulièrement vif pour nous, pour porter nos jugements. Les personnes qui sont guidées par le Système 1 sont plus sensibles au biais de disponibilité que les autres. Un exemple de ce biais serait d'écouter les nouvelles et d'entendre qu'un grand avion s'est écrasé dans un autre pays. Si vous aviez un vol la semaine suivante, vous pourriez avoir une croyance disproportionnée que votre vol va aussi s'écraser.

- L'erreur du coût irrécupérable: Ce sophisme se produit lorsque des personnes continuent à investir des ressources supplémentaires dans un compte perdant malgré la disponibilité de meilleurs investissements. Par exemple, lorsque les investisseurs laissent le prix d'achat d'une action déterminer le moment où ils peuvent la vendre, ils sont victimes de l'erreur des coûts irrécupérables. La tendance des investisseurs à vendre trop tôt les actions gagnantes et à conserver trop longtemps les actions perdantes a été bien étudiée. Un autre exemple est le fait de rester dans une relation à long terme, même si elle est émotionnellement dommageable. Les personnes concernées craignent de repartir à zéro, car cela signifierait que tout ce qu'elles ont fait dans le passé n'a servi à rien, mais cette crainte est généralement plus destructrice que le fait de lâcher prise. Cette erreur est également à l'origine de l'addiction aux jeux d'argent. Pour lutter contre ce sophisme, vous devez éviter de vous engager de plus en plus dans quelque chose qui pourrait échouer.

StoryShot #6 : Régression à la moyenne

La régression vers la moyenne est le fait statistique selon lequel toute séquence d'essais finit par converger vers la moyenne. Malgré cela, les humains ont tendance à identifier les séries chanceuses et malchanceuses comme des signes de résultats futurs, par exemple : j'ai perdu cinq fois de suite aux machines à sous, je dois donc gagner. Cette croyance est associée à plusieurs déficiences mentales que Kahneman examine :

- Illusion de compréhension : Nous construisons des récits pour donner un sens au monde. Nous cherchons la causalité là où elle n'existe pas.

- Illusion de validité : Les commentateurs, les sélectionneurs de titres et autres experts développent un sentiment d'expertise démesuré.

- L'intuition des experts : Les algorithmes appliqués avec discipline surpassent souvent les experts et leur sens de l'intuition.

- L'erreur de planification : Ce sophisme se produit lorsque des personnes surestiment les résultats positifs d'une expérience fortuite parce qu'elles ont planifié l'occasion.

- L'optimisme et l'illusion entrepreneuriale : La plupart des gens sont trop sûrs d'eux, ont tendance à négliger leurs concurrents et croient qu'ils vont faire mieux que la moyenne.

StoryShot #7 : Le recul influence significativement la prise de décision

À l'aide de divers éléments, Daniel Kahneman montre à quel point nous comprenons peu de choses de notre passé. Il mentionne le recul, un biais qui a un effet particulièrement négatif sur le processus de prise de décision. Plus précisément, la rétrospection déplace la mesure utilisée pour évaluer le bien-fondé des décisions. Ce changement déplace la mesure du processus lui-même vers la nature du résultat. Kahneman note que des actions qui semblaient prudentes dans la prévoyance peuvent sembler irresponsables et négligentes avec le recul.

L'une des limites générales de l'être humain est son incapacité à reconstituer avec précision les états passés des connaissances ou des croyances qui ont changé. Le biais de rétrospection a un impact significatif sur les évaluations des décideurs. Il conduit les observateurs à évaluer la qualité d'une décision non pas en fonction du bien-fondé du processus, mais en fonction du caractère positif ou négatif de son résultat.

La rétrospective est particulièrement désagréable pour les décideurs qui agissent en tant qu'agents pour d'autres personnes : médecins, conseillers financiers, entraîneurs de troisième ligne, PDG, travailleurs sociaux, diplomates et politiciens. Nous avons tendance à reprocher aux décideurs les bonnes décisions qui ont mal tourné. Nous leur accordons également trop peu de crédit pour des actions réussies qui n'apparaissent évidentes qu'après les résultats. Ainsi, chez les humains, il existe un biais évident en faveur des résultats.

Bien que la rétrospection et le biais du résultat favorisent généralement l'aversion au risque, ils apportent également des récompenses imméritées aux chercheurs de risques irresponsables. C'est le cas, par exemple, des entrepreneurs qui prennent des paris fous et gagnent par chance. Les leaders chanceux ne sont également jamais punis pour avoir pris trop de risques.

StoryShot #8 : Aversion pour le risque

Kahneman note que les êtres humains ont tendance à avoir une aversion pour le risque, ce qui signifie que nous avons tendance à éviter le risque chaque fois que nous le pouvons. La plupart des gens n'aiment pas le risque parce qu'ils risquent de recevoir le résultat le plus faible possible. Ainsi, si on leur propose de choisir entre un pari et un montant égal à sa valeur attendue, ils choisiront la valeur sûre. La valeur attendue est calculée en multipliant chacun des résultats possibles par la probabilité que chaque résultat se produise et en additionnant toutes ces valeurs. Un décideur ayant une aversion pour le risque choisira une valeur sûre inférieure à la valeur attendue du risque. En fait, il paie une prime pour éviter l'incertitude.

StoryShot #9 : L'aversion aux pertes

Kahneman introduit également le concept d'aversion aux pertes. De nombreuses options auxquelles nous sommes confrontés dans la vie sont un mélange de pertes et de gains potentiels. Il y a un risque de perte et une opportunité de gain. Nous devons donc décider si nous acceptons le pari ou si nous le rejetons.

L'aversion aux pertes fait référence à la force relative de deux motivations : nous sommes plus fortement poussés à éviter les pertes qu'à réaliser des gains. Un point de référence est parfois le statu quo, mais il peut aussi s'agir d'un objectif futur. Par exemple, ne pas atteindre un objectif est une perte ; dépasser l'objectif est un gain.

Les deux motivations n'ont pas la même puissance. L'aversion pour l'échec est bien plus forte que la motivation d'atteindre un objectif. Ainsi, les gens adoptent souvent des objectifs à court terme qu'ils s'efforcent d'atteindre mais pas nécessairement de dépasser. Ils sont susceptibles de réduire leurs efforts lorsqu'ils ont atteint des objectifs immédiats. Cela signifie que leurs résultats peuvent parfois violer la logique économique.

Kahneman explique également que les gens attachent de la valeur aux gains et aux pertes plutôt qu'à la richesse. Ainsi, les poids de décision qu'ils attribuent aux résultats sont différents des probabilités. Les personnes confrontées à des options terribles prennent des paris désespérés, acceptant une forte probabilité d'aggraver la situation en échange d'un faible espoir d'éviter une perte importante. Ce type de prise de risque transforme souvent des échecs gérables en catastrophes. Parce que la défaite est si difficile à accepter, le camp perdant dans les guerres se bat souvent bien au-delà du moment où la victoire est garantie pour l'autre camp.

StoryShot #10 : Ne faites pas confiance à vos préférences pour refléter vos intérêts

À propos des décisions, Daniel Kahneman suggère que nous partons tous du principe que nos décisions sont dans notre meilleur intérêt. Ce n'est généralement pas le cas. Nos souvenirs, qui ne sont pas toujours justes ou interprétés correctement, influencent souvent nos choix de manière significative.

Les décisions qui ne produisent pas la meilleure expérience possible sont une mauvaise nouvelle pour ceux qui croient en la rationalité du choix. Nous ne pouvons pas faire entièrement confiance à nos préférences pour refléter nos intérêts. Ce manque de confiance est réel, même si elles sont fondées sur l'expérience personnelle et les souvenirs récents.

StoryShot #11 : Les souvenirs façonnent nos décisions

Les souvenirs façonnent nos décisions. Ce qui est inquiétant, c'est que nos souvenirs peuvent être erronés. L'incohérence est intégrée dans la conception de notre esprit. Nous avons de fortes préférences quant à la durée de nos expériences de douleur et de plaisir. Nous voulons que la douleur soit brève et que le plaisir dure. Notre mémoire, une fonction du système 1, a évolué pour représenter les moments les plus intenses d'un épisode de douleur ou de plaisir. Une mémoire qui néglige la durée ne répondra pas à notre préférence pour les plaisirs longs et les douleurs courtes.

Une valeur unique de bonheur ne représente pas facilement l'expérience d'un moment ou d'un épisode. Bien que les émotions positives et négatives existent simultanément, il est possible de classer la plupart des moments de la vie comme étant finalement positifs ou négatifs. L'humeur d'un individu à un moment donné dépend de son tempérament et de son bonheur général. Pourtant, le bien-être émotionnel fluctue également chaque jour et chaque semaine. L'humeur du moment dépend principalement de la situation actuelle.

Résumé et analyse de Thinking Fast and Slow

La pensée, rapide et lente décrit la façon dont tous les esprits humains fonctionnent. Nous avons tous deux systèmes qui se soutiennent mutuellement et travaillent en tandem. Le problème se pose lorsque nous nous fions trop à notre système 1, rapide et impulsif. Cette confiance excessive conduit à un large éventail de préjugés qui peuvent influencer négativement la prise de décision. La clé est de comprendre d'où viennent ces préjugés et d'utiliser notre système analytique 2 pour garder notre système 1 sous contrôle.

Classement

Nous évaluons Penser vite et lentement 4.4/5. Quelle note donneriez-vous au livre de Daniel Kahneman sur la base de ce résumé ? Commentez ci-dessous et dites-nous ce que vous en pensez !

Résumé de l'infographie

Obtenir le résumé complet de l'infographie Thinking Fast and Slow (en anglais) sur l'application StoryShots.

Résumé de Thinking Fast and Slow PDF, livre audio gratuit et résumé animé

C'était la partie émergée de l'iceberg. Pour plonger dans les détails et soutenir l'auteur, commandez l'ouvrage livre ou obtenez le livre audio gratuitement sur Amazon.

Avez-vous aimé les leçons que vous avez apprises ici ? Commentez ci-dessous ou partagez-les pour montrer votre intérêt.

Nouveau sur StoryShots ? Obtenez le PDF, la version audio gratuite et la version animée de cette analyse et de ce résumé de Thinking Fast and Slow et de centaines d'autres livres de non-fiction à succès dans notre section "StoryShots". application gratuite de premier rang. Apple, The Guardian, les Nations unies et Google l'ont classée parmi les meilleures applications de lecture et d'apprentissage au monde.

Résumés de livres gratuits connexes

Bruit par Daniel Kahneman

Réfléchissez-y à nouveau par Adam Grant

Coup de coude par Richard Thaler

Predictably Irrational par Dan Ariely

Débit par Mihaly Csikszentmihalyi

Oser grandir par Brené Brown

Lorsque par Daniel H. Pink

Le cygne noir par Nassim Taleb

Tout est foutu par Mark Manson

Six chapeaux de réflexion par Edward De Bono

Comment ne pas se tromper par Jordan Ellenberg

Parler à des étrangers par Malcolm Gladwell

Tao Te Ching par Laozi

La marche sur la lune avec Einstein par Joshua Foer

Freakonomics par Stephen Dubner et Steven Levitt

Les lois de la nature humaine par Robert Greene

Un Commentaire